近年、自動車業界ではAI技術の活用が急速に進み、自動運転技術は目覚ましい発展を遂げています。一方で、AI、特に機械学習モデルが車両の判断や制御といったクリティカルな機能を担うようになり、その安全性をいかにして担保・証明するかが大きな技術的課題となっています。

国連欧州経済委員会(UNECE)における規制の整備も進む中、産業界の知見を結集した新たな国際標準として「ISO/PAS 8800:2024自動車-安全性及び人工知能」が発行されました。本規格は、自動車に搭載されるAIシステムの安全性に関する規格として、今後の開発・認証プロセスにおける新たな基盤となることが期待されています。

本稿では、このISO/PAS 8800の規格の概要を解説するほか、自動運転とAIの機能安全を巡る国際的な動向や、既存の安全規格であるISO 26262:2018 道路車両–機能安全や、ISO 21448:2022自動車-意図した機能の安全性(SOTIF)との連携について概説します。

1.自動運転とAIに関する国際的なルールの整備

自動車の安全に関する国際ルールは、UNECEの自動車基準調和世界フォーラム(WP.29)を中心に策定が進められています。近年、このWP.29において、自動運転およびAI技術の安全性を確保するための動きが活発化しており、「標準化から法規化へ」という潮流が形成されています。

2024年3月の第192回WP.29本会議において、レベル2相当の先進運転支援システム(ADAS)のサブセットである「ドライバーコントロール支援システム(DCAS)」(※)に関する新規則「UN-R171」が採択され、同年9月22日に発効しました。この規則が、DCASに対して安全要件を定めたことにより、DCASにおいてはISO 26262の準拠が前提となりました。

(※)レベル2運転支援機能に相当する縦方向及び横方向を持続的に制御する機能をいう。具体的な機能としては、車線維持支援機能、車線変更支援機能、交差点右左折支援機能等に対応している。

【参考】国土交通省資料

DCASのような既存技術の規制整備と並行し、WP.29配下の自動運転作業部会(GRVA)は、より新しい技術であるAIへの対応に向けた取り組みも行っています。

2025年3月の第195回WP.29本会議では、自動車分野におけるAIの安全な活用に関するガイダンス策定を目的とした「人工知能に関するインフォーマルワーキンググループ(AI IWG)」の設置が正式に承認されました。

このAI IWGでは、車載AIのユースケース整理、既存標準や規制の調査、そしてセーフティクリティカルなAIシステムを対象としたガイダンス文書を作成することが発表されています。

2.ISO/PAS 8800:2024の概要と目的

こうした国際的なルール整備の潮流の中、産業界の知見を取り入れて策定されたのが「ISO/PAS 8800:2024自動車-安全性及び人工知能」です。本章では、この新たな規格の目的と対象について整理します。

ISO/PAS 8800が目指すもの

2024年12月13日に発行されたISO/PAS 8800は、全172ページに及ぶPAS(Publicly Available Specification,公開仕様書)として、自動車分野におけるAI技術利用システムの安全確保に関する指針を提供しています。本PASの目的は、ISO 26262やISO 21448など従来の安全規格では十分にカバーされていなかったAI固有の課題に対応するために既存のアプローチをテーラリングまたは拡張したフレームワークを定義することです。

例えば、データ駆動型のAIモデルの設計要素を、ライフサイクル全体を通じて適切に管理するという課題に応えます。学習データの品質やカバレッジ、AIシステムの不確実性、運用中の継続的な再学習後の安全保証論証などを管理するためのプロセスや考慮事項を定義しています。これにより、ソフトウェア定義車両(SDV)に適合した、継続的に進化するシステムの安全性を担保することを目指します。

ISO/PAS 8800規格の適用対象

本PASの適用範囲は、量産車両に搭載される電気・電子(E/E)システムのうち、安全に関連し、かつAI技術を使用するシステムです。より具体的には、以下の2つが主たる対象となります。

- AIシステム: 1つ以上のAIモデルを用いる車両レベルのアイテム(機能)またはその要素。

- AIモデルおよびAIコンポーネント: 上記のAIシステム内部に組み込まれた、AIモデルそのものや、AIモデルを含むソフトウェアコンポーネント。

一方で、AIを含まない従来のシステムやコンポーネントは対象外であり、従来の規格が適用されます。この明確な区分により、既存の安全開発プロセスにAI特有の管理手法を追加する形で、シームレスな連携が可能となります。

3.AI安全管理の中核「AI安全ライフサイクル参照モデル」

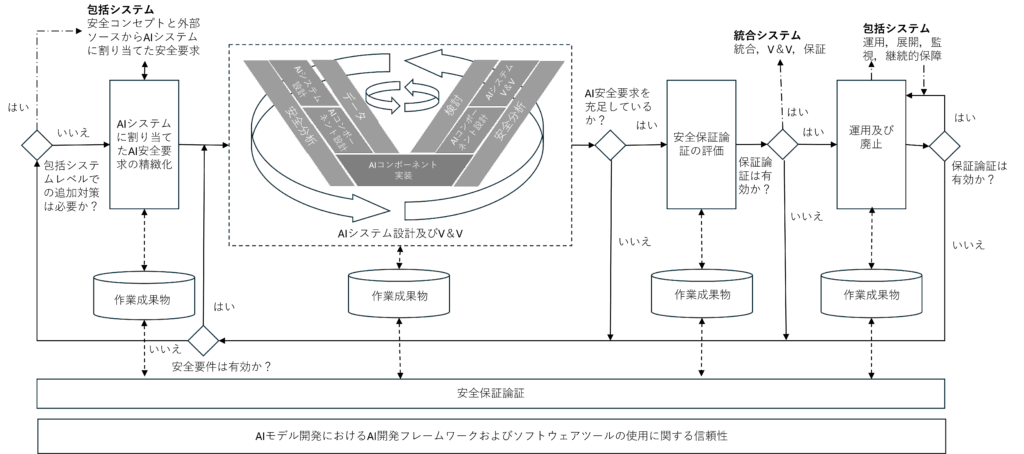

ISO/PAS 8800の第7章では、本規格の根幹をなすAI安全ライフサイクルの参照モデルが提示されています。これは、AI技術を用いたシステムの開発から運用、廃止に至るまでの全フェーズを俯瞰し、一貫した安全管理を行うための枠組みです。

AI安全ライフサイクル参照モデルの特徴と狙い

AI安全ライフサイクル参照モデルは、AIシステムに割り当てられた安全性要求の導出から、設計、検証・妥当性確認、そして市場投入後の運用に至る各フェーズを繰り返し実行し、その過程で生成される作業成果物を記録することが要求されます。

このライフサイクルには、AIシステム設計とV&Vのプロセスも含まれます。このプロセスは、V字モデルの従来の開発プロセスと異なり、反復的なアプローチを特徴としています。このプロセスの目的は、AIシステムやAIモデルに潜在する機能不足(例:性能の不十分さ、未知の状況への対応漏れ)やその根本原因を分析によって特定し、適切な対策を実装して機能不足を解消することにあります。PDCA(計画-実行-検証-改善)サイクルを開発全体で回すことにより、AIを含むシステムの安全性を段階的に成熟させていくことが狙いです。

AI安全ライフサイクル参照モデルで重要となるプロセス

AI安全ライフサイクル参照モデルには、従来の機能安全プロセスに加え、AI特有のリスクに対応するためのプロセスが複数提示されています。 ポイントは以下の3つです。

①データの管理

ISO/PAS 8800のAI安全ライフサイクル参照モデルでは、データはAIの安全性を左右する最も重要な要素の1つに位置づけられています。

特に学習データや検証データの収集・選定・ラベリング・品質管理が明示されています。これらはAIモデルの性能や信頼性を直接的に左右するものです。

②AI特有のリスクに対応する検証と安全分析

検証・妥当性確認(V&V)や安全性分析は、従来のソフトウェア開発や機能安全でも実施されるプロセスです。ただしISO/PAS 8800では、AI特有の課題――たとえばデータの偏り、AIモデルの不透明性、学習過程や更新による性能変動――に対応するために、安全分析を繰り返し行うことを求めています。

従来の分析手法の枠組みに、AI固有のリスクを検出・評価する視点を組み込む必要があるのです。

③AIの安全性の証明と運用

ISO/PAS 8800は、AI要素について「safety assurance argument(安全保証論証)」を作成することを明示しています。「プロジェクトごとに様々な検証とテストにより問題ない証拠を積み上げて安全性を立証すべし」ということです。

また、運用段階での継続的な安全確保(フィールドデータによる評価や再学習、アップデートなど)も明記しています。市場投入後も視野に入れ、OTA 等による変更時も含め、安全管理をライフサイクルの一部として扱うことが求められているのです。

4.既存の安全規格との連携~ISO 26262とISO 21448~

ISO/PAS 8800は、既存の安全規格であるISO 26262(機能安全)およびISO 21448(SOTIF)と連携し、補完し合うことでAIシステムの安全性を実現することを目指しています。

ISO 26262との役割分担と補完関係

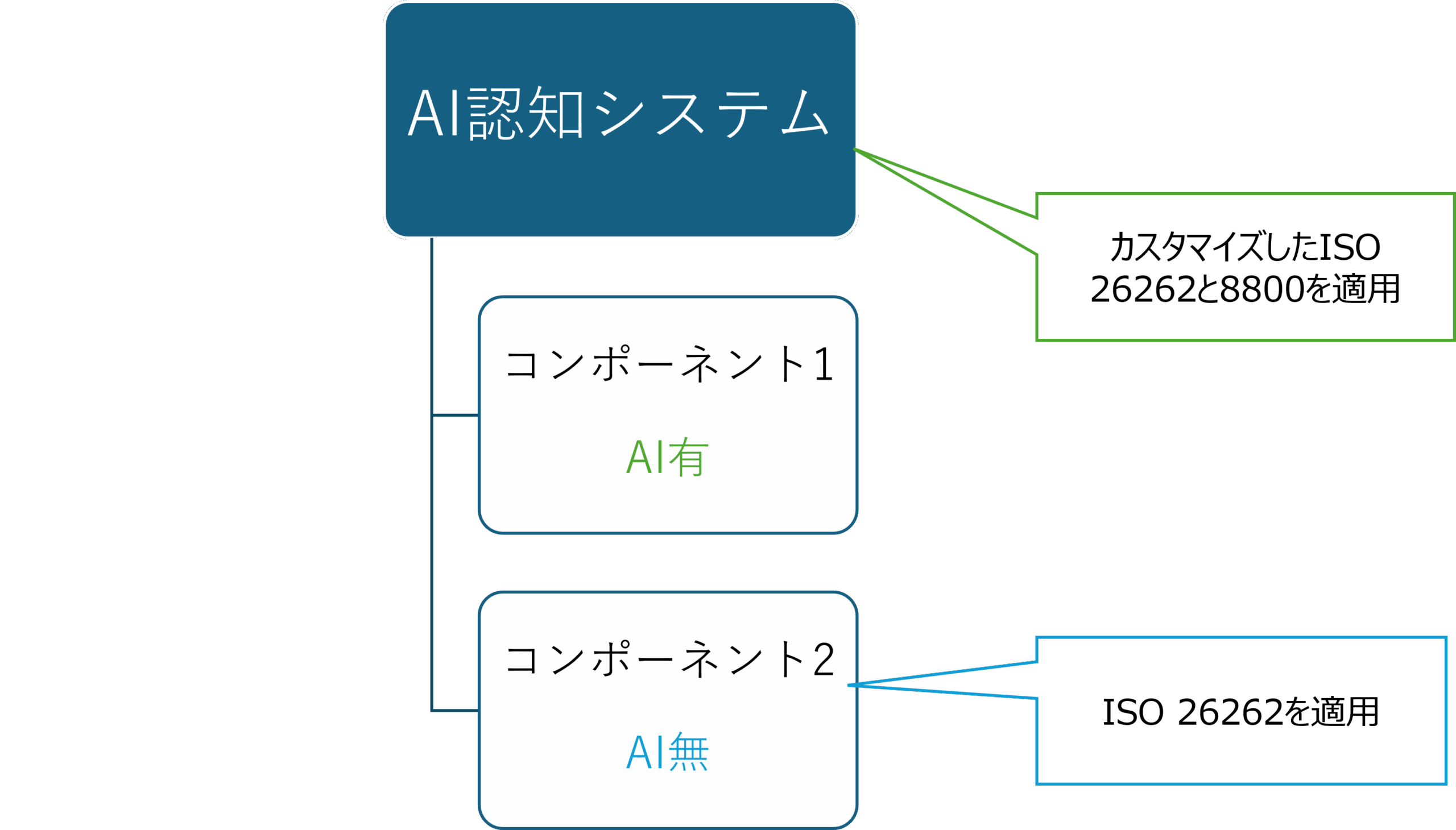

ISO/PAS 8800は、ISO 26262と組み合わせて適用されることが意図されていますが、両者が前提とするシステムには違いがあります。

従来のISO 26262は、開発が完了した時点で機能や仕様が固定される静的なシステムを主な対象としてきました。一方で、ISO/PAS 8800は、AIモデルが市場投入後もOTAアップデートなどを通じて継続的に学習・改善されていく動的なシステムを考慮しなければなりません。

例えば、AIで物体を認識するシステムが、AIモデルを内包する「コンポーネント1(AI有り)」と、従来のロジックで制御される「コンポーネント2(AI無し)」で構成されている場合、適用すべき規格は以下の図のようになります。

コンポーネント2(AI無し)は、従来のコンポーネントであるため、ISO 26262のみを適用します。コンポーネント1(AI有り)とAI認知システム全体は、AI特有のリスクを管理する必要があるため、ISO/PAS 8800と、AIの特性を考慮してプロセスを調整したカスタマイズ版のISO 26262の両方を適用する必要があります。

この関係性を整理すると、両規格には以下の表のような違いがあり、互いに補完し合う関係にあることが分かります。

| ISO 26262 | ISO/PAS 8800 | |

| 対象システム | AIを用いない車載E/Eシステム全般 | AI技術を組み込んだ安全関連システム |

| ライフサイクルの特徴 | 開発完了時点で仕様が固定された設計を前提 | 継続的な学習・更新を許容しており、反復的・進化的 |

| 考慮するリスク | ハードウェア故障、システム設計ミスなど | AIシステムの不確実性、性能不足など |

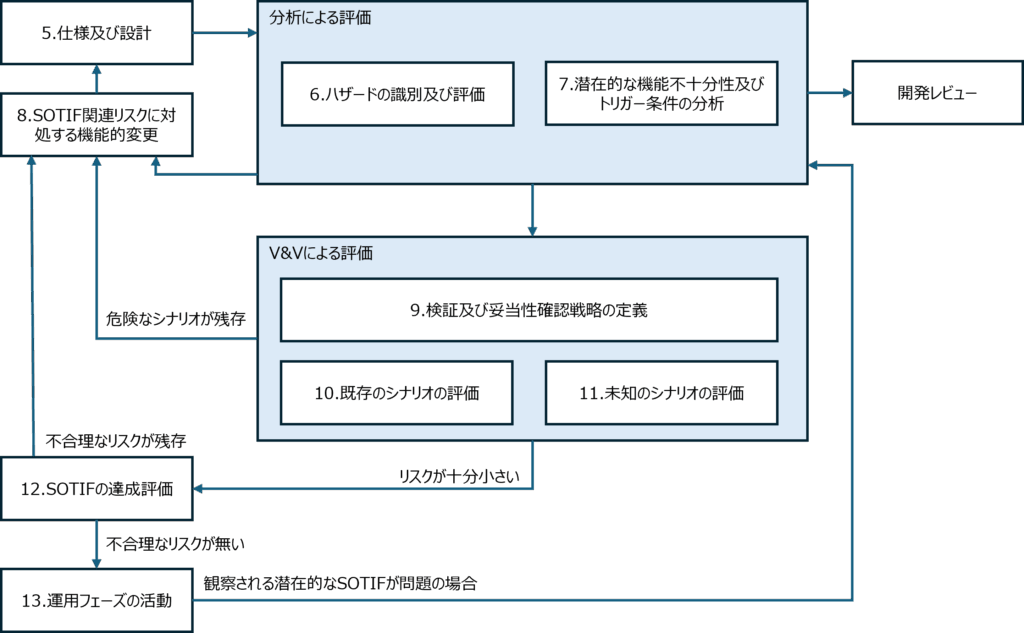

ISO21448(SOTIF)との連携による不合理リスク管理

AIシステムの安全確保には、故障だけでなく、意図した機能そのものが持つ性能限界や、予見可能な誤使用に起因するリスク(不合理なリスク)への対処も不可欠です。この領域を専門に扱うのがISO 21448(SOTIF: Safety of the Intended Functionality)です。

ISO/PAS 8800は、SOTIFとも用語の対応付けと分析手順の調整を図っています。例えば、AIシステムに誤動作を引き起こす「AIトリガー条件」が、結果として「AIエラー」を誘発し、危険な車両挙動に至るという因果関係を定義し、これをSOTIFにおける危険シナリオの分析フレームワークに組み込みます。

これにより、AIの認識・判断に影響を与える膨大な環境・入力シナリオを体系的に洗い出し、AIモデルが誤動作するリスクを評価し、対策を講じるというSOTIFのPDCAサイクルをAIシステムに適用できます。

特に、「市場投入後にフィールドデータを活用して未知の危険シナリオを発見し、システム更新で対処する」というISO/PAS 8800の継続的改善の考え方は、SOTIFの精神と合致しており、両規格の連携によってAIシステムの安全性を合理的に追求できます。

上の図は、ISO 21448が定める活動のプロセスを示したものです。

まず『仕様及び設計(5)』から始まり、『分析による評価(6, 7)』でハザードや潜在的な機能不全を洗い出します。その後、『V&Vによる評価(9, 10, 11)』で既知および未知のシナリオを評価し、もし『危険なシナリオ』や『不合理なリスク』が残存していれば、再び設計や分析のフェーズに戻り対策を講じます。

このように、開発から運用までを見据えてPDCAサイクルを回し、リスクが許容可能なレベルになるまで改善を繰り返すのがSOTIFの基本的な考え方です。

まとめ

STELAQは、ソフトウェア開発の上流から開発・検証・教育まで一気通貫で支援。国際規格適合コンサルティングサービスでは、規格調査からギャップ分析、社内合意形成の支援や社員教育に至るまで、開発現場への適用と定着に向けたサポートをします。OEM出身を含む自動車業界に精通したコンサルタントやSGS-TÜV認定AISPの有資格者が、機能安全をはじめとする規格対応と開発内製化の実現を力強く後押しします。

- 車載ソフトウェア開発×一気通貫:立ち上げ期~要件定義~開発~テストまで、プロジェクト全体をワンストップで支援

- 規格への対応力:機能安全(ISO 26262)をはじめ国際/業界標準に準拠したプロセス設計・定着を実行

- 自走化まで伴走:経営層報告・社員教育・PM育成を通じ、最終的な内製化と継続的な品質向上を実現

まずはお気軽にご相談ください。